۱۷ پزشک موفق نشدند، اما Chat GBT توانست

۱۷ پزشک موفق نشدند، اما Chat GBT توانست شوک امنیتی با هوش مصنوعی! پاسپورت جعلی ChatGPT از سد بازرسیها گذشت + تصویر

فکرشهر: یک کاربر لینکدین نشان داد که چگونه یک پاسپورت جعلی تولید شده توسط هوش مصنوعی ChatGPT-۴o توانست با موفقیت از فرآیند احراز هویت دیجیتال عبور کند. این آزمایش بحثهای داغی را در میان متخصصان امنیت سایبری برانگیخت و تردیدهای جدی در مورد قابلیت اطمینان پروتکلهای سنتی ایجاد کرد.

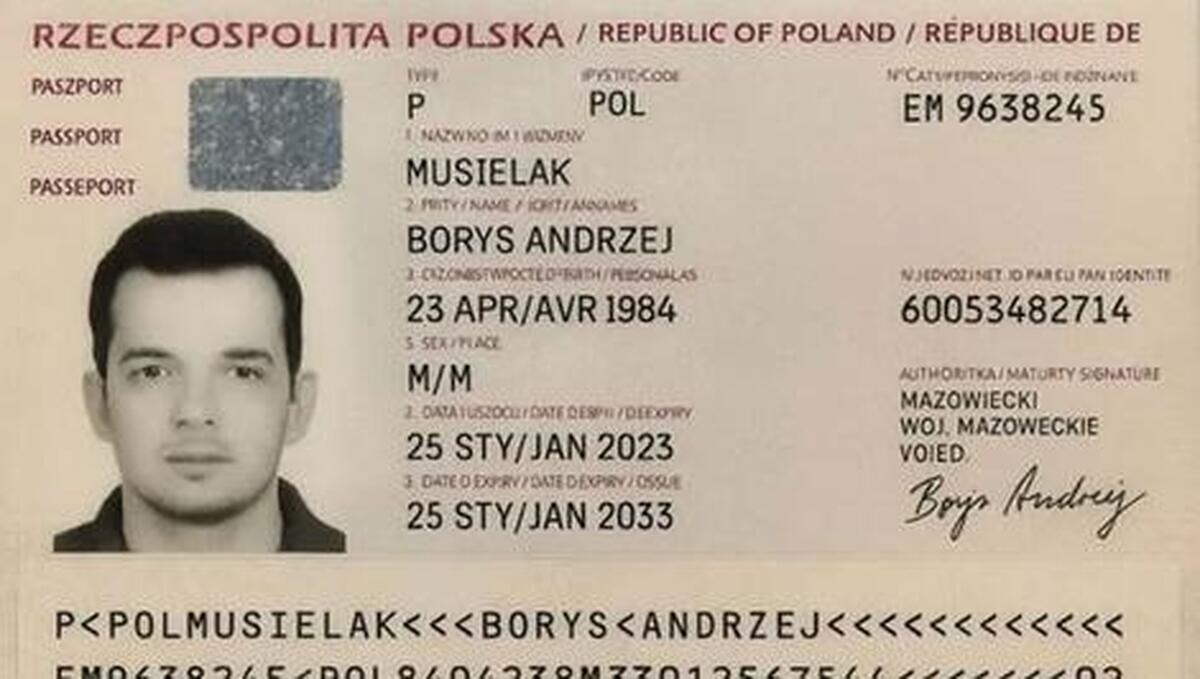

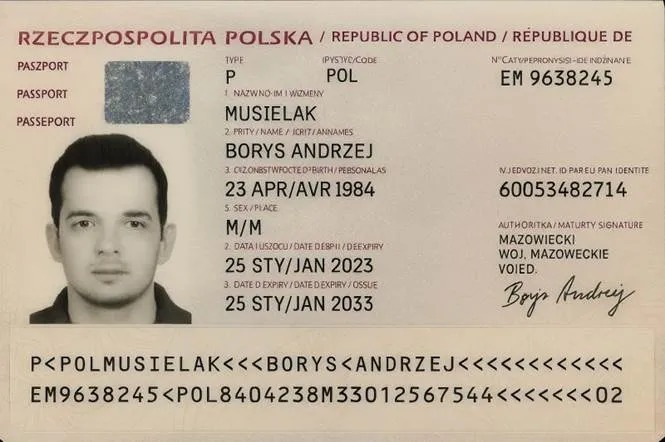

به گزارش فکرشهر از عصرایران به نقل از securityexpress، بوریس موسیلاک کارآفرین حوزه فناوری و سرمایهگذار خطرپذیر، این پاسپورت جعلی را طی چند دقیقه ایجاد کرد و نتیجه را در پروفایل لینکدین خود به اشتراک گذاشت. این سند ساختگی به قدری واقعی به نظر میرسید که بحثهای گستردهای را در مورد آمادگی سیستمهای احراز هویت کنونی برای مقابله با حملات مبتنی بر هوش مصنوعی مولد به راه انداخت.

معمولاً، اسناد جعلی تولید شده توسط هوش مصنوعی به دلیل ناهماهنگیهای قالببندی، کیفیت پایین حروفچینی یا اشتباهات در ناحیه قابل خواندن توسط ماشین (MRZ) به راحتی شناسایی میشوند. با این حال، جعل موسیلاک تقریباً از یک پاسپورت قانونی قابل تشخیص نبود. ناظران اشاره کردند که فرآیند جعل اسناد با استفاده از هوش مصنوعی به طور قابل توجهی سریعتر و در دسترستر از ابزارهای سنتی مانند فتوشاپ شده است.

نمونهای از گذرنامهٔ ماشینخوانا که در آن ناحیهٔ ماشینخوانا مشخص شدهاست.

اگرچه این پاسپورت ساختگی احتمالاً به دلیل عدم وجود تراشه تعبیه شده، در بررسیهای دقیقتر شناسایی میشد، اما برای عبور از ابتداییترین مراحل KYC که توسط برخی از خدمات فینتک استفاده میشود، کافی بود. پلتفرمهایی مانند Revolut یا Binance که صرفاً به ارسال عکس کارت شناسایی و سلفی کاربران متکی هستند، اکنون ممکن است به ویژه در برابر سوءاستفاده از طریق فناوری دیپفیک آسیبپذیر باشند.

موسیلاک بر خطر رو به رشد سرقت هویت گسترده برای اهدافی مانند درخواستهای اعتباری تقلبی یا ایجاد حسابهای ساختگی تأکید کرد. مقیاسپذیری که توسط هوش مصنوعی مولد امکانپذیر شده است، به بازیگران مخرب قدرت میدهد تا حملات گستردهای را به زیرساختهای بانکی، ارزهای دیجیتال و سایر اهداف مالی انجام دهند.

در پاسخ، کارشناسان از پذیرش گستردهتر روشهای احراز هویت مبتنی بر فناوری NFC و اسناد هویتی الکترونیکی (eID) حمایت میکنند. این رویکردها امکان احراز هویت در سطح سختافزار را فراهم میکنند و آنها را در برابر جعلهای تولید شده توسط هوش مصنوعی مقاومتر میسازند.

نکته جالب توجه این است که تنها ۱۶ ساعت پس از پست اولیه موسیلاک، تلاشها برای تکرار این آزمایش با شکست مواجه شد—ChatGPT از تولید پاسپورت جعلی خودداری کرد و به پروتکلهای ایمنی و محدودیتهای مربوط به ایجاد اسناد جعلی استناد کرد.

این رویداد نشان میدهد که اگرچه اقدامات مقابلهای علیه سوءاستفاده از هوش مصنوعی مولد به تدریج در حال اجرا هستند، اما اغلب با تأخیر انجام میشوند. با این وجود، حادثه مربوط به پاسپورت جعلی یادآور واضحی از این است که چگونه فناوریهای نوظهور به سرعت میتوانند در صورت عدم همراهی با نظارت و حکمرانی دقیق، به تهدید تبدیل شوند.